Phương sai phương pháp chung (CMV – Common Method Variance) là phương sai phát sinh do phương pháp đo lường thay vì từ cấu trúc lý thuyết của các biến nghiên cứu. Nguyên nhân chính là việc sử dụng duy nhất một bảng hỏi tự đánh giá (self-report) để đo lường cả biến độc lập và biến phụ thuộc cùng một thời điểm. Giải pháp nhanh nhất là áp dụng kiểm định Harman’s Single Factor Test trên phần mềm SPSS hoặc tối ưu hóa thiết kế bảng hỏi để chẩn đoán và kiểm soát sai số hệ thống.

1. Phương sai phương pháp chung (CMV) là gì?

- Định nghĩa chi tiết: Trong lĩnh vực đo lường tâm lý học (Psychometrics) và phân tích thống kê, phương sai phương pháp chung là sự biến thiên có hệ thống của dữ liệu gây ra bởi phương pháp thu thập dữ liệu, làm sai lệch kết quả đo lường các cấu trúc lý thuyết (constructs).

- So sánh sự khác biệt: So với phương sai thực (true variance) phản ánh đúng bản chất của đối tượng nghiên cứu, phương sai phương pháp chung tạo ra sự tương quan giả tạo. Khác với sai số ngẫu nhiên (random error) thường tự triệt tiêu, sai số từ CMV mang tính hệ thống và làm tăng hoặc giảm hệ số tương quan giữa các biến một cách phi thực tế.

- Luận điểm chính: Lý thuyết về CMV lập luận rằng kết quả của một phép đo là hàm số của ba yếu tố: đặc tính thực sự của biến, tác động của phương pháp đo lường, và sai số ngẫu nhiên. Nếu không bóc tách được tác động của phương pháp, mô hình nghiên cứu sẽ bị sai lệch.

- Các thành phần cốt lõi:

- Hiệu ứng từ người trả lời (Rater effects): Tính nhất quán giả tạo, tính mong muốn xã hội.

- Hiệu ứng từ đặc điểm mục hỏi (Item characteristic effects): Độ phức tạp của câu hỏi, thang đo được sử dụng.

- Hiệu ứng ngữ cảnh (Item context effects): Cách sắp xếp vị trí các câu hỏi trong bảng khảo sát.

- Mục tiêu cốt lõi: Mục đích cuối cùng của việc nghiên cứu và kiểm soát phương sai phương pháp chung là đảm bảo độ giá trị cấu trúc (construct validity), từ đó khẳng định tính chính xác của các giả thuyết khoa học.

2. Lịch sử hình thành và phát triển của lý thuyết

Sự phát triển của việc nhận diện và kiểm soát phương sai phương pháp chung gắn liền với nền tảng khoa học đo lường định lượng:

- Giai đoạn Khởi nguồn: Campbell và Fiske (1959) – Tác phẩm kinh điển về Ma trận đa đặc điểm – đa phương pháp (MTMM – Multitrait-Multimethod Matrix). Hai tác giả đã đặt câu hỏi làm thế nào để phân biệt sự tương quan thực sự giữa các khái niệm và sự tương quan do dùng chung một phương pháp đo lường. Giải pháp của họ là yêu cầu đo lường nhiều đặc điểm bằng nhiều phương pháp khác nhau để đối chiếu chéo.

- Giai đoạn Hoàn thiện/Phát triển: Podsakoff, MacKenzie, Lee và Podsakoff (2003) – Nghiên cứu hệ thống hóa các nguồn gốc gây ra sai lệch phương pháp chung và đề xuất các biện pháp kiểm soát. Tác phẩm này đóng góp khung phân tích hoàn chỉnh, định chuẩn hóa việc sử dụng Harman’s Single Factor Test và các công cụ thống kê nâng cao (như Common Latent Factor) để xử lý dữ liệu.

3. Các miền nội dung khái niệm cốt lõi (Core Concepts)

Để hiểu sâu về sai số hệ thống này, nhà nghiên cứu cần nắm vững các giả định nền tảng về hành vi của người tham gia khảo sát:

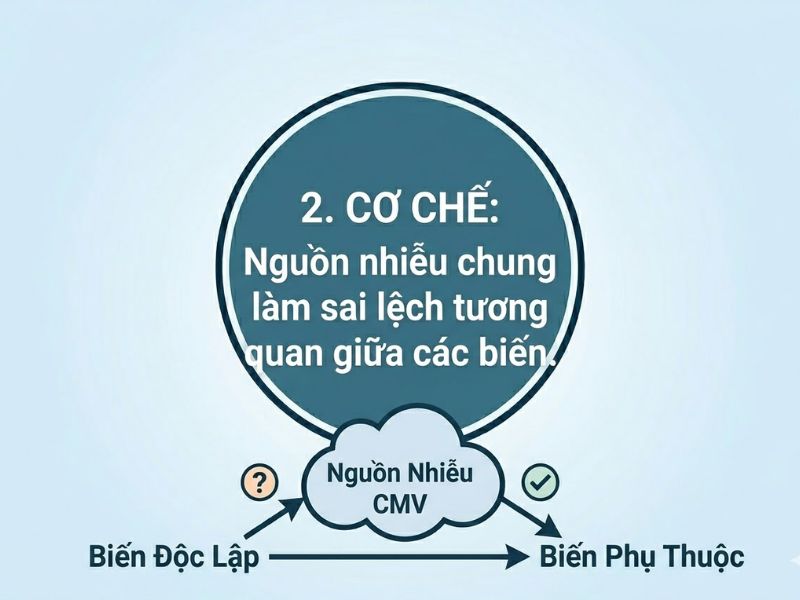

- Giả định 1: Giới hạn nhận thức và tính nhất quán (Consistency Motif): Con người có xu hướng duy trì sự nhất quán trong nhận thức. Khi phải trả lời một loạt câu hỏi liên tiếp cho cả biến độc lập và biến phụ thuộc, họ tự động thiết lập một mối liên hệ logic giả tạo giữa các câu trả lời để tạo sự đồng nhất.

- Giả định 2: Tính mong muốn xã hội (Social Desirability): Hành vi của người cung cấp dữ liệu thường bị chi phối bởi tiêu chuẩn xã hội. Họ có xu hướng cung cấp thông tin tích cực về bản thân và che giấu các yếu tố tiêu cực, làm méo mó phương sai thực.

Các đặc tính/biến số quan trọng:

- Nguồn cung cấp dữ liệu (Data Source): Việc sử dụng một nguồn duy nhất (single-source) sẽ làm tăng nguy cơ sai số cao nhất.

- Định dạng thang đo (Scale Format): Sử dụng lặp đi lặp lại cùng một định dạng (ví dụ: toàn bộ đều dùng thang đo Likert 5 điểm) tạo ra sự rập khuôn trong phản xạ đánh giá.

- Bối cảnh đo lường (Measurement Context): Không gian và thời gian đo lường đồng thời làm mất đi sự độc lập giữa các biến số.

Bảng so sánh các thành phần của phương sai trong đo lường định lượng:

| Tiêu chí | Phương sai thực (True Variance) | Phương sai phương pháp (Method Variance) | Sai số ngẫu nhiên (Random Error) |

| Bản chất | Phản ánh chính xác thuộc tính của cấu trúc lý thuyết cần đo. | Phản ánh sự sai lệch có hệ thống do công cụ/cách thức đo lường. | Những biến thiên không lường trước, không có quy luật. |

| Tính hệ thống | Tính hệ thống cao, đúng định hướng lý thuyết. | Tính hệ thống cao, gây nhiễu định hướng lý thuyết. | Không có tính hệ thống (phân phối chuẩn quanh mức 0). |

| Hậu quả | Tăng độ tin cậy và độ giá trị cấu trúc. | Vi phạm phương sai phương pháp chung, làm sai lệch hệ số tương quan (Type I/II error). | Làm giảm hệ số tin cậy (Reliability), biến thiên dữ liệu rộng. |

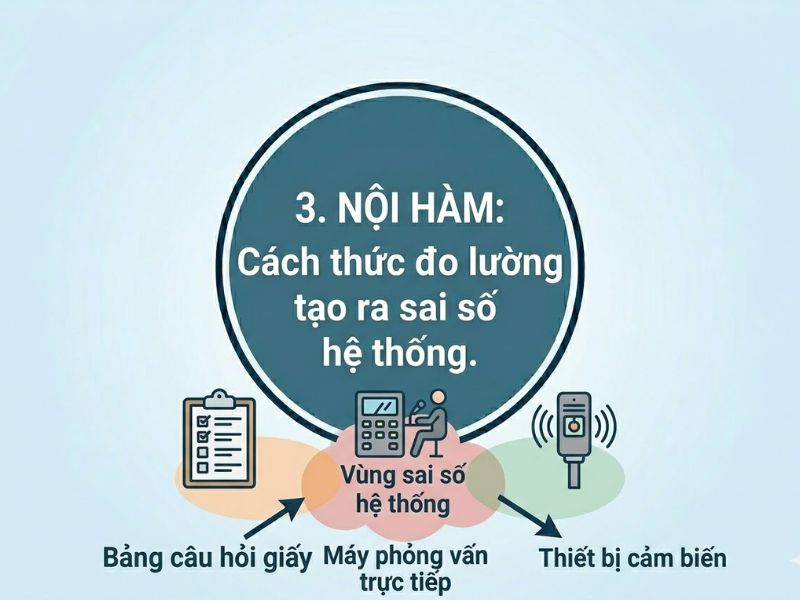

4. Nội hàm các khái niệm và Thang đo các biến (Measurement Scales)

Trong nghiên cứu định lượng, việc đo lường và kiểm soát phương sai phương pháp chung được thực hiện thông qua các thủ tục thống kê trên phần mềm SPSS.

Đo lường mức độ ảnh hưởng bằng Harman’s Single Factor Test:

Kỹ thuật này sử dụng Phân tích nhân tố khám phá (EFA) không xoay để xem liệu có một nhân tố duy nhất chi phối tập dữ liệu hay không. Quy trình thực hiện trên SPSS bao gồm các bước:

- Mở tập dữ liệu trên phần mềm SPSS.

- Chọn Analyze > Dimension Reduction > Factor.

- Đưa toàn bộ các biến quan sát (items) của biến độc lập, trung gian và phụ thuộc vào khung Variables. Tuyệt đối không đưa biến nhân khẩu học.

- Tại mục Extraction: Chọn Principal Components. Mục Extract chọn Fixed number of factors và nhập giá trị 1.

- Tại mục Rotation: Chọn None (Không xoay nhân tố).

- Bấm OK và kiểm tra bảng Total Variance Explained.

Tiêu chí đánh giá: Nếu tỷ lệ phương sai trích (Cumulative %) của nhân tố duy nhất này dưới 50%, tập dữ liệu được đánh giá là không bị vi phạm sai số phương pháp nghiêm trọng.

5. Các nghiên cứu liên quan tiêu biểu (Related Studies)

- Nhóm 1: Các bài báo nền tảng (Foundational Works):

- Podsakoff, P. M., MacKenzie, S. B., Lee, J. Y., & Podsakoff, N. P. (2003). “Common method biases in behavioral research: A critical review of the literature and recommended remedies.” Journal of Applied Psychology. Tác phẩm này định chuẩn hệ thống phân loại nguyên nhân gây ra phương sai phương pháp chung và tổng hợp các giải pháp thống kê triệt để.

- Nhóm 2: Ứng dụng trong Quản trị kinh doanh:

- Conway, J. M., & Lance, C. E. (2010). “What reviewers should expect from authors regarding common method bias in organizational research.” Journal of Business and Psychology. Nghiên cứu này thiết lập các tiêu chuẩn mà hội đồng phản biện khoa học yêu cầu tác giả phải thực hiện để chứng minh dữ liệu không bị sai lệch do dùng chung một phương pháp khảo sát.

- Nhóm 3: Phân tích tổng hợp (Meta-Analysis):

- Cote, J. A., & Buckley, R. (1987). “Estimating trait, method, and error variance: Generalizing across 70 construct validation studies.” Journal of Marketing Research. Nghiên cứu chứng minh rằng khoảng 26% phương sai trong các nghiên cứu hành vi bị chi phối bởi phương pháp đo lường.

6. Những mặt hạn chế và khoảng trống nghiên cứu (Limitations)

Không có công cụ thống kê nào kiểm soát sai số đo lường một cách hoàn hảo. Các giới hạn của lý thuyết và công cụ kiểm soát bao gồm:

- Hạn chế về bối cảnh (Harman test không nhạy): Harman’s Single Factor Test thường bị xem là một kỹ thuật bảo thủ và kém nhạy. Việc dữ liệu hiển thị một nhân tố chiếm dưới 50% phương sai không đảm bảo hoàn toàn việc loại trừ được sai số phương pháp.

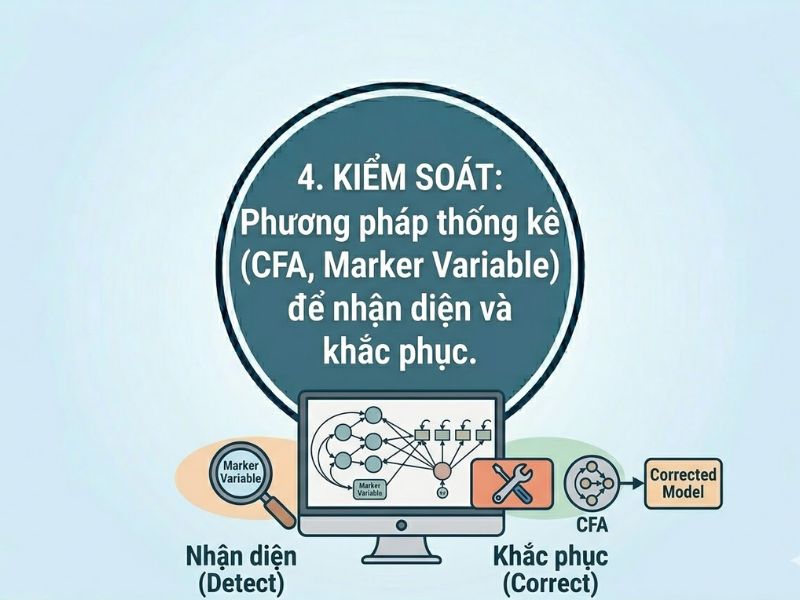

- Hạn chế về đo lường: Nếu nhà nghiên cứu không chủ động đưa một “biến đánh dấu” (Marker variable – một biến không có liên hệ lý thuyết với mô hình) vào khảo sát ngay từ đầu, việc bóc tách phương sai phương pháp ra khỏi phương sai thực trong AMOS/PLS-SEM sẽ thiếu độ chính xác.

- Hạn chế về giả định: Các giải pháp thống kê (Statistical remedies) chỉ mang tính chất chẩn đoán và bù đắp sau khi sự việc đã xảy ra (post-hoc). Nếu thiết kế khảo sát ban đầu đã vi phạm nguyên tắc khoa học, không có thuật toán nào khôi phục được giá trị thực của dữ liệu.

7. Các hướng nghiên cứu (Research Applications)

Việc kiểm soát phương sai phương pháp chung mở ra các hướng phát triển thiết kế nghiên cứu nâng cao:

- Kết hợp với Lý thuyết Phương trình Cấu trúc (SEM): Sử dụng nhân tố ngầm định chung (Common Latent Factor – CLF). CLF được thêm vào mô hình đo lường để tính toán trực tiếp mức độ phương sai do phương pháp gây ra, cải thiện độ giá trị so với cách dùng Harman test truyền thống.

- Kết hợp với Thiết kế Nghiên cứu Theo chiều dọc (Longitudinal Design): Loại bỏ hoàn toàn CMV bằng cách tiến hành thu thập dữ liệu biến độc lập ở thời điểm T1 và dữ liệu biến phụ thuộc ở thời điểm T2. Độ trễ về thời gian (time lag) phá vỡ tính nhất quán giả tạo của người phản hồi.

8. Cách ứng dụng lý thuyết vào thực tiễn doanh nghiệp (Practical Application)

Việc nắm vững nguyên lý sai số phương pháp cung cấp bộ công cụ tư duy cho các nhà quản lý trong việc thiết kế hệ thống đánh giá thực tiễn:

- Ứng dụng 1: Đo lường hiệu suất nhân sự: Khi đánh giá nhân sự, nhà quản lý không nên chỉ dựa vào tự đánh giá (self-report). Cần sử dụng phương pháp phản hồi 360 độ (kết hợp cấp trên, đồng nghiệp, khách hàng) để loại bỏ tính mong muốn xã hội và sai số từ một nguồn dữ liệu.

- Ứng dụng 2: Nghiên cứu thị trường và trải nghiệm khách hàng: Khi khảo sát mức độ hài lòng của khách hàng và ý định mua lại, bộ phận R&D cần thiết kế câu hỏi đa dạng thang đo, tách biệt các nhóm câu hỏi và đảo ngược câu hỏi (reverse-coded items) để tránh tình trạng khách hàng đánh dấu ngẫu nhiên theo một đường thẳng.

- Ứng dụng 3: Tối ưu hóa thu thập dữ liệu B2B: Đối với các dự án lớn, doanh nghiệp cần thu thập số liệu tài chính trực tiếp từ hệ thống ERP thay vì hỏi ý kiến chủ quan của quản lý cấp trung, nhằm tránh tương quan giả tạo giữa hành vi lãnh đạo và kết quả tài chính.

9. Các câu hỏi thường gặp (FAQ)

Harman’s Single Factor Test có phải là phương pháp tuyệt đối để loại trừ phương sai phương pháp chung không?

Không, Harman’s Single Factor Test chỉ là phương pháp chẩn đoán ban đầu. Kỹ thuật này không loại bỏ được sai số mà chỉ đưa ra cảnh báo về sự tồn tại của nó. Nhà nghiên cứu cần kết hợp với kỹ thuật Common Latent Factor (CLF) để kiểm soát triệt để hơn.

Mức dưới 50% trong kiểm định Harman dựa trên tiêu chuẩn tài liệu nào?

Mức dưới 50% được xác định dựa trên tiêu chuẩn nghiên cứu của Podsakoff et al. (2003). Công trình này chỉ ra rằng nếu một nhân tố không chi phối đa số (>50%) biến thiên của dữ liệu thì phương pháp đo lường không tạo ra sai số ở mức báo động.

Phải làm gì nếu tập dữ liệu vi phạm CMV trên phần mềm SPSS?

Nhà nghiên cứu bắt buộc phải xây dựng mô hình đo lường bổ sung. Bạn cần sử dụng phần mềm AMOS hoặc SmartPLS để thêm nhân tố CLF vào mô hình, sau đó so sánh trọng số hồi quy chuẩn hóa trước và sau khi thêm CLF. Nếu sự chênh lệch nhỏ hơn 0.2, dữ liệu vẫn có thể tiếp tục phân tích.

10. Kết luận

Kiểm soát phương sai phương pháp chung không chỉ là một rào cản mang tính khái niệm hàn lâm mà là kim chỉ nam bắt buộc để bảo vệ tính hợp lệ của mọi kết quả thống kê. Bằng cách áp dụng chặt chẽ các biện pháp phòng ngừa trong khâu thiết kế thang đo và thao tác kiểm định Harman’s Single Factor Test trên SPSS, các nhà nghiên cứu và quản trị gia có thể loại bỏ sai lệch, đảm bảo các quyết định kinh doanh được dựa trên những nền tảng dữ liệu trung thực.

Việc am hiểu các sai số hệ thống trong phân tích định lượng chính là bước tiến quan trọng nâng cao chất lượng nền tảng nghiên cứu khoa học chuyên nghiệp và đáng tin cậy.

Giảng viên Nguyễn Thanh Phương là chuyên gia chuyên sâu về Nghiên cứu khoa học, Ứng dụng AI, Digital Marketing và Quản trị bản thân. Với kinh nghiệm giảng dạy thực chiến, tác giả trực tiếp hướng dẫn ứng dụng phương pháp luận và phân tích dữ liệu chuyên sâu cho người học nên được sinh viên gọi là Thầy giáo quốc dân. Mọi nội dung chia sẻ đều tuân thủ nguyên tắc khách quan, thực chứng và mang giá trị ứng dụng cao, hướng tới mục tiêu cốt lõi: “Làm bạn tốt hơn!