Vấn đề xác định dữ liệu mẫu có tính đại diện hay không là thách thức lớn trong phân tích định lượng. Để giải quyết trọn vẹn bài toán này, các nhà nghiên cứu cần một thước đo chuẩn xác. Kiểm định Shapiro-Wilk là phương pháp thống kê dùng để kiểm tra phân phối chuẩn của các biến liên tục. Nguyên nhân chính gây sai lệch kết quả nghiên cứu là do vi phạm các giả định thống kê về phân phối dữ liệu, dẫn đến các sai lầm trong suy diễn. Giải pháp nhanh nhất và chính xác nhất cho cỡ mẫu nhỏ (n < 50) là áp dụng kiểm định Shapiro-Wilk trên các phần mềm như SPSS hoặc R để xác định hướng đi tiếp theo cho dữ liệu. Đây là tiêu chuẩn học thuật được công nhận rộng rãi trong các hội đồng khoa học quốc tế.

1. Giới thiệu tổng quan về kiểm định Shapiro-Wilk (Introduction)

1.1. Khái niệm và mục đích cốt lõi

Kiểm định Shapiro-Wilk là một phương pháp kiểm định thống kê được đề xuất bởi Samuel Sanford Shapiro và Martin Wilk vào năm 1965. Trong hệ thống thống kê suy diễn, mục đích cốt lõi của phương pháp này là kiểm tra phân phối chuẩn (Test of Normality) của một tập dữ liệu cụ thể. Phương pháp này đánh giá xem một mẫu dữ liệu ngẫu nhiên có được rút ra từ một tổng thể mang phân phối chuẩn hay không. Việc sử dụng kiểm định Shapiro-Wilk cung cấp cơ sở toán học vững chắc để các nhà nghiên cứu đưa ra kết luận về đặc tính của tập dữ liệu đang xét. Bằng chứng định lượng này có độ tin cậy vượt trội hơn hẳn so với việc chỉ quan sát dữ liệu bằng trực giác, giúp hệ thống hóa quy trình kiểm tra dữ liệu đầu vào.

1.2. Tầm quan trọng trong phân tích thống kê

Trong lĩnh vực phân tích dữ liệu, việc xác định đúng phân phối của tập dữ liệu là điều kiện tiên quyết. Các mô hình thống kê chỉ phát huy sức mạnh tối đa khi tập dữ liệu gốc thỏa mãn các điều kiện nền tảng. Kiểm định Shapiro-Wilk đóng vai trò là một màng lọc bắt buộc trước khi nhà nghiên cứu quyết định áp dụng các kiểm định tham số (như T-test, ANOVA) hay các kiểm định phi tham số (như Mann-Whitney U, Kruskal-Wallis). Việc vi phạm giả định phân phối chuẩn mà vẫn cố tình sử dụng kiểm định tham số sẽ dẫn đến sai số loại I hoặc loại II, làm mất đi tính hợp lệ của toàn bộ nghiên cứu. Đặc biệt trong các lĩnh vực như y sinh học hay tâm lý học – nơi cỡ mẫu bị giới hạn, việc áp dụng bài kiểm tra này là bước bảo chứng chất lượng cốt lõi.

2. Nguyên lý hoạt động và Giả thuyết thống kê (Definition/Concept)

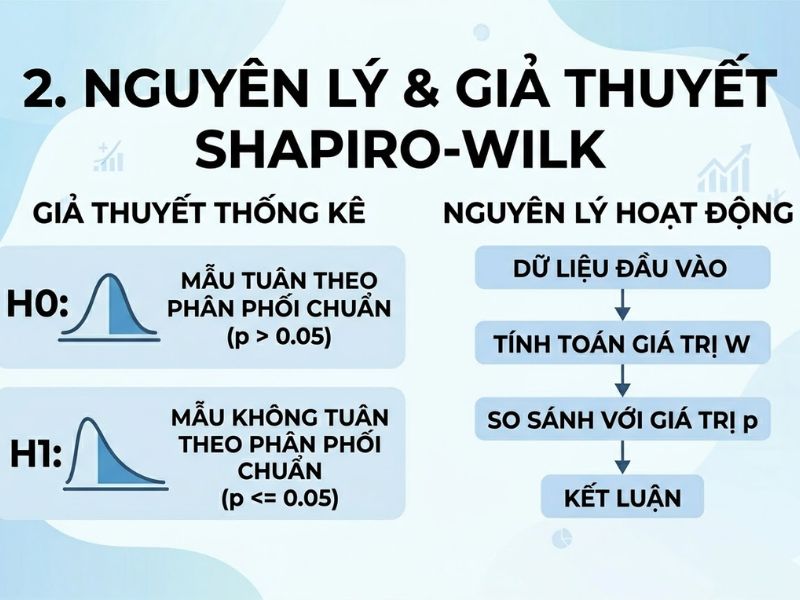

2.1. Cặp giả thuyết H0 và H1 trong kiểm định

Như mọi phương pháp kiểm định giả thuyết thống kê khác, kiểm định Shapiro-Wilk được xây dựng dựa trên một cặp giả thuyết loại trừ lẫn nhau:

- Giả thuyết H0 (Null hypothesis): Tập dữ liệu tuân theo quy luật phân phối chuẩn.

- Giả thuyết H1 (Alternative hypothesis): Tập dữ liệu không tuân theo quy luật phân phối chuẩn.

Kết quả của kiểm định sẽ cung cấp cơ sở bằng chứng để nhà nghiên cứu ra quyết định bác bỏ hay không bác bỏ giả thuyết H0 dựa trên mức ý nghĩa (α) đã thiết lập trước. Quy tắc logic này là nền tảng để đảm bảo tính khách quan tuyệt đối trong quy trình tiền xử lý số liệu.

2.2. Cơ sở toán học (Lược khảo)

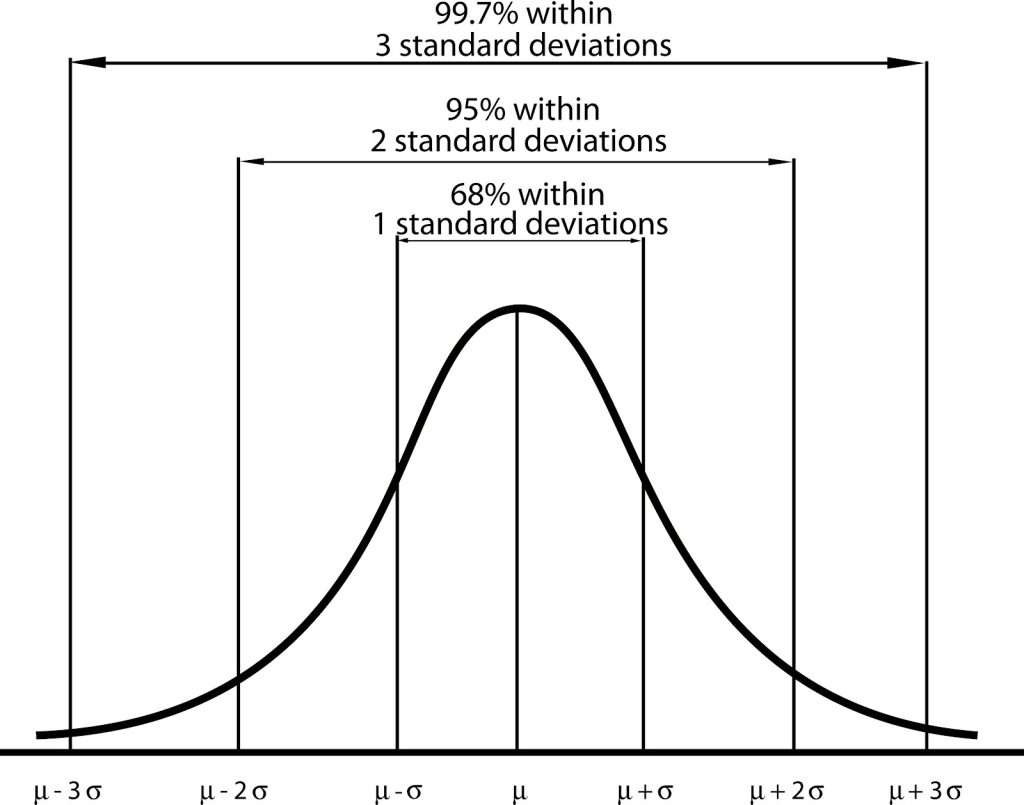

Nguyên lý toán học của kiểm định Shapiro-Wilk dựa trên việc tính toán giá trị thống kê W (W-statistic). Về bản chất cấu trúc, giá trị W được xác định thông qua việc đo lường mức độ tương quan bình phương giữa dữ liệu thực tế đã được sắp xếp theo thứ tự và các điểm phân vị chuẩn lý thuyết tương ứng. Giá trị W luôn nằm trong khoảng từ 0 đến 1. Giá trị W càng gần 1, dữ liệu càng có xu hướng tuân theo phân phối chuẩn.

Tương tự như cách đánh giá các chỉ số độ khớp mô hình (GoF – Goodness of Fit) thông qua hệ số R², Q² trong thuật toán PLS-SEM, hay các tiêu chí bắt buộc như SRMR ≤ 0.08 và GFI ≥ 0.90 trong thuật toán CB-SEM, hệ số W phản ánh mức độ tương thích định lượng của mẫu dữ liệu đối với đường cong phân phối chuẩn lý tưởng.

3. Điều kiện áp dụng kiểm định Shapiro-Wilk (In-depth Analysis)

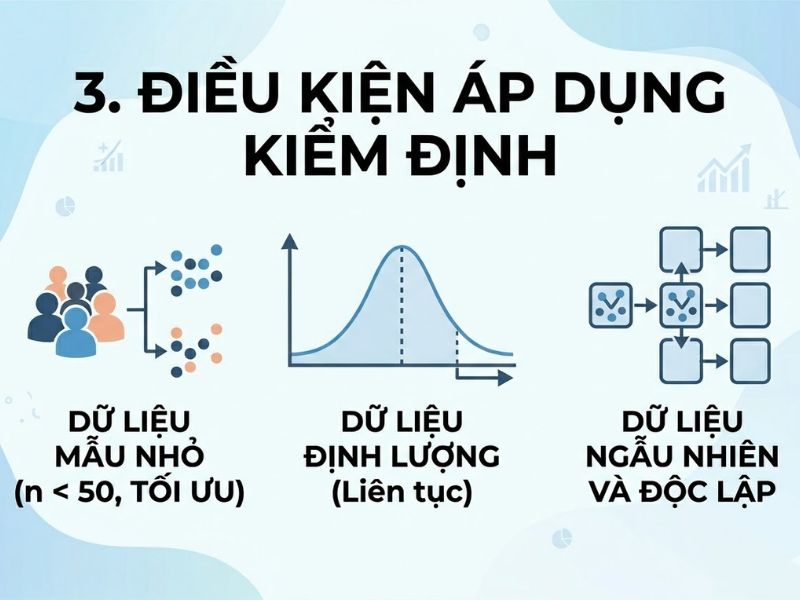

3.1. Giới hạn cỡ mẫu (Sample Size n < 50)

Kiểm định Shapiro-Wilk được chứng minh là “tiêu chuẩn tối ưu” đối với các dữ liệu có cỡ mẫu nhỏ. Dựa trên các căn cứ toán học, các giới hạn này được quy định cụ thể:

- Khoảng cỡ mẫu tối ưu: 3 ≤ n ≤ 50. Việc giới hạn cỡ mẫu trong phạm vi này giúp triệt tiêu các sai số do tính nhạy cảm quá mức của hệ thống thống kê gây ra.

- Sức mạnh thống kê (Statistical power): Các nghiên cứu mô phỏng Monte Carlo chỉ ra rằng kiểm định Shapiro-Wilk cung cấp sức mạnh thống kê cao nhất so với các kiểm định khác khi cỡ mẫu nhỏ. Nó cực kỳ nhạy bén trong việc phát hiện sự sai lệch khỏi phân phối chuẩn ở đuôi của phân phối. Điều này đồng nghĩa xác suất phát hiện đúng tập dữ liệu bị lệch của phương pháp này vượt trội hoàn toàn so với các công cụ tương đương.

3.2. Yêu cầu về loại dữ liệu

Để kết quả của kiểm định Shapiro-Wilk đảm bảo tính hợp lệ, dữ liệu đầu vào bắt buộc phải đáp ứng các tiêu chí sau:

- Dữ liệu phải là biến định lượng (Quantitative variables).

- Dữ liệu phải có tính chất liên tục (Continuous data).

- Các quan sát trong mẫu phải độc lập với nhau.

Sự vi phạm bất kỳ yếu tố nào trong ba điều kiện trên đều khiến giá trị p-value mất đi ý nghĩa thực tiễn, đồng thời phá vỡ hệ thống giả định căn bản của phương pháp.

4. Phân biệt kiểm định Shapiro-Wilk và kiểm định Kolmogorov-Smirnov (In-depth Analysis)

Việc nhầm lẫn giữa hai phương pháp này rất phổ biến. Dưới đây là sự phân biệt rõ ràng để lựa chọn công cụ chính xác cho từng bối cảnh thiết kế nghiên cứu chuyên biệt.

4.1. Khác biệt về độ mạnh thống kê (Statistical Power)

Kiểm định Shapiro-Wilk có độ mạnh thống kê vượt trội hơn hẳn khi đánh giá tính chuẩn xác của dữ liệu, đặc biệt là khả năng phát hiện độ lệch (skewness) và độ nhọn (kurtosis). Ngược lại, kiểm định Kolmogorov-Smirnov kém nhạy cảm hơn ở các vùng đuôi phân phối và thường dễ dàng chấp nhận giả thuyết H0 một cách sai lầm nếu không có sự hiệu chỉnh bổ sung (như hiệu chỉnh Lilliefors). Sự chênh lệch này đến từ việc Kolmogorov-Smirnov chỉ đo lường khoảng cách phân phối tuyệt đối, trong khi Shapiro-Wilk đi sâu vào cấu trúc phương sai.

4.2. Khác biệt về tiêu chí cỡ mẫu

| Tiêu chí so sánh | Kiểm định Shapiro-Wilk | Kiểm định Kolmogorov-Smirnov |

| Cỡ mẫu tối ưu | Cỡ mẫu nhỏ (n < 50). Một số phần mềm hiện đại hỗ trợ lên đến n = 2000. | Cỡ mẫu lớn (n ≥ 50). |

| Sức mạnh thống kê | Rất cao đối với cỡ mẫu nhỏ. Nhạy với sự bất thường ở đuôi phân phối. | Trung bình. Ít nhạy cảm với các bất thường ở đuôi phân phối. |

| Khuyến nghị sử dụng | Tiêu chuẩn tối ưu cho dữ liệu thực nghiệm, y sinh học, tâm lý học có cỡ mẫu giới hạn. | Phù hợp cho bộ dữ liệu điều tra diện rộng, big data cơ bản. |

5. Hướng dẫn đọc và diễn giải kết quả kiểm định (Solutions/Methods)

5.1. Phân tích giá trị p (p-value) và mức ý nghĩa Alpha (α)

Mức ý nghĩa (α) thường được thiết lập ở mức 0.05 (tương ứng độ tin cậy 95%). Việc diễn giải kết quả kiểm định Shapiro-Wilk trên các nền tảng phần mềm như SPSS, R, hoặc Python tuân theo quy tắc sau:

- Nếu giá trị p < 0.05: Bác bỏ giả thuyết H0. Kết luận: Dữ liệu không có phân phối chuẩn. Nhà nghiên cứu cần chuyển sang dùng các phương pháp kiểm định phi tham số.

- Nếu giá trị p > 0.05: Không có đủ bằng chứng để bác bỏ giả thuyết H0. Kết luận: Dữ liệu tuân theo phân phối chuẩn. Nhà nghiên cứu đủ điều kiện áp dụng các kiểm định tham số.

Việc tuân thủ nghiêm ngặt chỉ số alpha = 0.05 giúp kiểm soát rủi ro xảy ra sai lầm loại I trong suy diễn thống kê.

5.2. Kết hợp với các phương pháp kiểm tra bằng đồ thị (Graphical Methods)

Dựa dẫm hoàn toàn vào giá trị p là một sai lầm trong thống kê thực hành, đặc biệt khi cỡ mẫu lớn làm tăng độ nhạy của kiểm định đối với những sai lệch cực nhỏ. Do đó, cần kết hợp kết quả kiểm định Shapiro-Wilk với các biểu đồ trực quan để có cái nhìn toàn diện:

- Biểu đồ Q-Q plot (Quantile-Quantile plot): Nếu các điểm dữ liệu phân bổ bám sát đường chéo tiêu chuẩn, phân phối là chuẩn. Sự lệch pha ở hai phần đuôi đường chéo thể hiện đặc điểm đuôi nặng hoặc đuôi nhẹ.

- Biểu đồ Histogram: Trực quan hóa độ lệch (skewness) và kiểm tra hình dạng hình chuông đặc trưng của dữ liệu phân tán.

- Biểu đồ Boxplot: Xác định sự tồn tại của các giá trị ngoại lai (outliers) gây biến dạng phân phối. Bất kỳ quan sát nào nằm ngoài giới hạn của Boxplot đều có khả năng khiến giá trị W giảm mạnh.

6. Tổng kết (Conclusion)

Kiểm định Shapiro-Wilk là công cụ phân tích dữ liệu quan trọng, cung cấp cơ sở đánh giá độ tin cậy để xác định phân phối chuẩn cho các cỡ mẫu nhỏ. Bằng cách thiết lập chuẩn mực chặt chẽ thông qua việc đánh giá giá trị p và kiểm định các giả định thống kê, phương pháp này giúp các nhà nghiên cứu đưa ra lựa chọn kiểm định tham số hay kiểm định phi tham số chính xác. Hiểu và áp dụng đúng kiểm định Shapiro-Wilk không chỉ là yêu cầu bắt buộc về mặt toán học mà còn là minh chứng cho tính nghiêm cẩn, độ chính xác và tính hợp lệ của mọi dự án nghiên cứu khoa học. Việc kết hợp công cụ định lượng này cùng đồ thị định tính sẽ là nền móng vững chắc định hình chất lượng phân tích của dữ liệu đầu vào.

7. Câu hỏi thường gặp (FAQ)

Dữ liệu không đạt kiểm định Shapiro-Wilk thì cần xử lý như thế nào?

Nếu p-value < 0.05, bạn có hai hướng xử lý chính. Thứ nhất, thực hiện chuyển đổi dữ liệu (Data transformation) như Logarit, Căn bậc hai hoặc hàm Box-Cox để đưa cấu trúc dữ liệu về dạng chuẩn. Thứ hai, sử dụng trực tiếp các phương pháp kiểm định phi tham số thay thế (ví dụ: dùng kiểm định Mann-Whitney U thay cho Independent T-test). Lựa chọn này được đưa ra dựa trên bản chất đo lường thực tế của biến số nghiên cứu.

Có thể áp dụng kiểm định Shapiro-Wilk cho cỡ mẫu lớn hơn 50 trên SPSS không?

Hoàn toàn có thể. Các thuật toán hiện đại trên phần mềm SPSS, R hay Python đã cải tiến kiểm định Shapiro-Wilk (thông qua bản mở rộng của Royston) để xử lý kích thước mẫu lên đến n = 2000 hoặc thậm chí n = 5000. Tuy nhiên, với khối lượng dữ liệu cực lớn, kiểm định này có xu hướng quá nhạy cảm và dễ dàng bác bỏ giả thuyết H0 chỉ vì một sai lệch nhỏ, do đó cần bắt buộc kết hợp đối chiếu với biểu đồ Q-Q plot để ra quyết định cuối cùng.

Giảng viên Nguyễn Thanh Phương là chuyên gia chuyên sâu về Nghiên cứu khoa học, Ứng dụng AI, Digital Marketing và Quản trị bản thân. Với kinh nghiệm giảng dạy thực chiến, tác giả trực tiếp hướng dẫn ứng dụng phương pháp luận và phân tích dữ liệu chuyên sâu cho người học nên được sinh viên gọi là Thầy giáo quốc dân. Mọi nội dung chia sẻ đều tuân thủ nguyên tắc khách quan, thực chứng và mang giá trị ứng dụng cao, hướng tới mục tiêu cốt lõi: “Làm bạn tốt hơn!