Độ tin cậy liên quan sát viên (Inter-rater reliability) là chỉ số thống kê đo lường mức độ đồng thuận giữa các nhà nghiên cứu độc lập khi đánh giá cùng một tập dữ liệu. Nguyên nhân chính gây sai lệch trong nghiên cứu định tính là sự chủ quan ngẫu nhiên của người mã hóa. Giải pháp nhanh và chính xác nhất là sử dụng hệ số Cohen’s Kappa (cho 2 người) hoặc Fleiss’ Kappa (nhiều hơn 2 người) để chuẩn hóa phép đo.

1. Khái niệm cơ bản về Độ tin cậy liên quan sát viên (Inter-rater reliability)

1.1. Định nghĩa Độ tin cậy liên quan sát viên là gì?

Độ tin cậy liên quan sát viên là một thước đo học thuật xác định mức độ nhất quán mà các chuyên gia đánh giá (rater) độc lập gán các giá trị giống nhau cho cùng một hiện tượng hoặc biến số quan sát. Trong nghiên cứu định lượng và định tính, tỷ lệ phần trăm đồng thuận đơn thuần (Percent agreement) không được chấp nhận làm tiêu chuẩn duy nhất vì nó không loại trừ khả năng các rater vô tình đánh giá giống nhau do ngẫu nhiên (chance agreement). Do đó, các hệ số thống kê chuyên sâu được áp dụng để loại bỏ yếu tố sai số ngẫu nhiên này.

1.2. Vai trò trong nghiên cứu khoa học và mã hóa dữ liệu định tính

Việc thiết lập và báo cáo độ tin cậy liên quan sát viên mang lại các giá trị cốt lõi sau:

- Đảm bảo tính khách quan (Objectivity): Giảm thiểu thành kiến cá nhân (bias) của từng nhà nghiên cứu trong quá trình phân tích văn bản, hình ảnh hoặc sự kiện.

- Xác nhận tính giá trị (Validity): Chứng minh rằng sổ tay mã hóa (codebook) được thiết kế rõ ràng, không gây hiểu lầm và có khả năng ứng dụng thực tế cao.

- Tính lặp lại của nghiên cứu (Replicability): Cho phép các nhóm nghiên cứu khác nhau sử dụng cùng một hệ thống mã hóa và đạt được kết quả tương đương, đáp ứng tiêu chuẩn khắt khe của các tạp chí khoa học quốc tế.

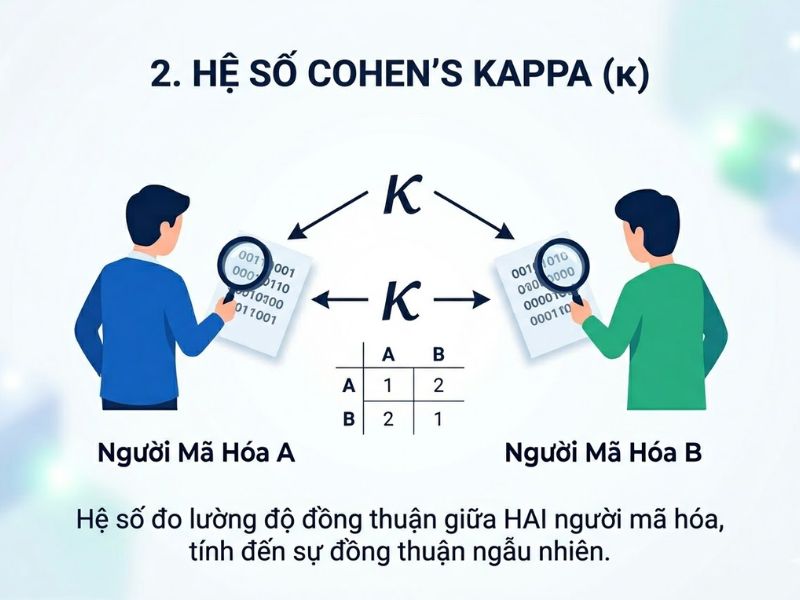

2. Hệ số Cohen’s Kappa là gì? (Đánh giá độ đồng thuận cho 2 người mã hóa)

2.1. Định nghĩa và bản chất thống kê của Cohen’s Kappa

Hệ số Cohen’s Kappa là một phép đo thống kê phi tham số được sử dụng để đánh giá độ đồng thuận giữa đúng hai người quan sát (two raters) tiến hành phân loại n mục vào C danh mục (categories) loại trừ lẫn nhau. Bản chất thống kê của Cohen’s Kappa là tính toán sự nhất quán thực tế sau khi đã trừ đi phần trăm nhất quán được kỳ vọng sẽ xảy ra một cách ngẫu nhiên.

2.2. Công thức tính Cohen’s Kappa

Hệ số Cohen’s Kappa được tính bằng công thức toán học sau:

Kappa = (Po – Pe) / (1 – Pe)

Trong đó:

- Po (Tỷ lệ đồng thuận quan sát được – Observed agreement): Tỷ lệ các trường hợp mà hai người mã hóa đưa ra kết quả hoàn toàn giống nhau.

- Pe (Tỷ lệ đồng thuận ngẫu nhiên – Expected agreement): Tỷ lệ kỳ vọng hai người mã hóa đưa ra kết quả giống nhau một cách tình cờ, dựa trên phân phối biên của các đánh giá.

3. Cách tính độ đồng thuận khi có nhiều hơn 2 người cùng mã hóa dữ liệu định tính (Fleiss’ Kappa)

3.1. Giới hạn của Cohen’s Kappa

Nhược điểm lớn nhất của hệ số Cohen’s Kappa là cấu trúc toán học của nó chỉ giới hạn ở việc so sánh độ đồng thuận cặp (pairwise) giữa chính xác hai người đánh giá. Khi một dự án nghiên cứu quy mô lớn đòi hỏi ba, bốn hoặc nhiều người cùng mã hóa dữ liệu định tính độc lập, Cohen’s Kappa hoàn toàn không có khả năng xử lý số liệu tổng thể, dẫn đến sai lệch nếu bị ép dùng sai mục đích.

3.2. Giới thiệu và ứng dụng hệ số Fleiss’ Kappa

Fleiss’ Kappa là giải pháp thay thế trực tiếp và mở rộng của Scott’s pi, được thiết kế để đo lường độ đồng thuận khi có số lượng người quan sát (Multiple raters) lớn hơn 2. Điểm đặc biệt của hệ số này là nó có thể áp dụng ngay cả khi số lượng người đánh giá thay đổi cho từng mục cụ thể (ví dụ: mục 1 do rater A, B, C đánh giá; mục 2 do rater B, C, D đánh giá), miễn là tổng số đánh giá trên mỗi mục là một hằng số cố định.

4. Hướng dẫn diễn giải hệ số Cohen’s Kappa và Fleiss’ Kappa

4.1. Khung đánh giá mức độ đồng thuận (Landis & Koch, 1977)

Để diễn giải kết quả thu được từ thuật toán, các nhà nghiên cứu thường sử dụng tiêu chuẩn quy chiếu của Landis & Koch (1977). Bảng cấu trúc dưới đây hệ thống hóa các ngưỡng giá trị:

| Giá trị Kappa | Mức độ đồng thuận (Strength of Agreement) | Ý nghĩa trong nghiên cứu định tính |

| Nhỏ hơn 0 | Kém (Poor) | Bất đồng hệ thống, sự đồng thuận thực tế thấp hơn ngẫu nhiên. |

| 0.01 – 0.20 | Rất yếu (Slight) | Cần xem xét lại toàn bộ sổ tay mã hóa. |

| 0.21 – 0.40 | Yếu (Fair) | Độ tin cậy thấp, dữ liệu cần được rà soát. |

| 0.41 – 0.60 | Trung bình (Moderate) | Đạt ngưỡng tối thiểu cho các nghiên cứu thăm dò ban đầu. |

| 0.61 – 0.80 | Đáng kể (Substantial) | Độ tin cậy tốt, đủ tiêu chuẩn xuất bản tạp chí khoa học. |

| 0.81 – 1.00 | Hoàn hảo (Almost perfect) | Sự đồng thuận tuyệt đối, quy trình mã hóa tối ưu. |

4.2. Các yếu tố ảnh hưởng đến giá trị Kappa

Việc diễn giải hệ số Kappa cần chú ý đến 2 hiện tượng sai số thống kê phổ biến:

- Nghịch lý tỷ lệ hiện mắc (Prevalence paradox): Xảy ra khi một hạng mục mã hóa xuất hiện với tần suất quá cao hoặc quá thấp trong mẫu dữ liệu, làm giảm giá trị Kappa một cách giả tạo mặc dù tỷ lệ phần trăm đồng thuận quan sát được (Po) rất cao.

- Thành kiến rater (Rater Bias): Sự chênh lệch tỷ lệ biên (marginal distributions) khi một rater có xu hướng ưu tiên chọn một mã danh mục nhất định một cách hệ thống so với người còn lại.

5. Quy trình thực hành tính toán độ đồng thuận trong nghiên cứu

5.1. Thu thập và chuẩn bị dữ liệu mã hóa

- Thiết lập Codebook: Cung cấp định nghĩa, quy tắc và ví dụ cụ thể cho từng danh mục mã hóa.

- Đào tạo Rater: Các người đánh giá thực hành trên một tập mẫu dữ liệu nhỏ (Pilot test) để làm quen.

- Mã hóa độc lập: Các rater tiến hành mã hóa toàn bộ hoặc một tỷ lệ mẫu ngẫu nhiên (thường là 10-20%) của tập dữ liệu chính thức mà không trao đổi với nhau.

5.2. Tính toán trên các phần mềm thống kê (SPSS, R, NVivo)

- Phần mềm SPSS: Sử dụng quy trình Analyze -> Descriptive Statistics -> Crosstabs, chọn biến độc lập của 2 rater, và tích vào ô Kappa trong mục Statistics.

- Phần mềm R: Cài đặt package irr. Dùng lệnh kappa2() cho 2 rater hoặc kappam.fleiss() khi sử dụng mô hình đa đánh giá (Fleiss’ Kappa).

- Phần mềm NVivo: Tính hợp tính năng Coding Comparison Query. Phần mềm sẽ tự động trích xuất bảng báo cáo hiển thị chỉ số tỷ lệ đồng thuận (%) và hệ số Cohen’s Kappa đối với các đoạn văn bản cụ thể.

6. Tầm quan trọng của Độ tin cậy liên quan sát viên trong ra quyết định khoa học

Việc thiết lập và kiểm định Độ tin cậy liên quan sát viên là yêu cầu mang tính bắt buộc để đảm bảo sự chặt chẽ về mặt phương pháp luận trong mã hóa dữ liệu định tính. Nếu hệ số Cohen’s Kappa và Fleiss’ Kappa không đạt ngưỡng “Đáng kể” (trên 0.61), các phân tích, giả thuyết và quyết định học thuật tiếp theo sẽ hoàn toàn mất đi tính hợp lệ. Áp dụng chính xác các chỉ số này là minh chứng trực tiếp cho chất lượng nghiên cứu khoa học.

7. Câu hỏi thường gặp (FAQ)

Hệ số Cohen’s Kappa âm có ý nghĩa gì?

Hệ số Kappa mang giá trị âm (nhỏ hơn 0) chỉ ra rằng sự đồng thuận thực tế của những người mã hóa còn thấp hơn cả tỷ lệ đồng thuận xảy ra một cách ngẫu nhiên. Nguyên nhân cốt lõi là sự bất đồng có tính hệ thống, thường xuất phát từ việc hiểu sai nghiêm trọng các hướng dẫn trong sổ tay mã hóa.

Khi nào nên sử dụng phần trăm đồng thuận (Percent agreement) thay vì Cohen’s Kappa?

Tuyệt đối không sử dụng tỷ lệ phần trăm đồng thuận làm chỉ số đo lường duy nhất vì nó chứa sai số ngẫu nhiên. Chỉ nên sử dụng chỉ số này như một dữ liệu tham khảo, báo cáo song song cùng Cohen’s Kappa để cung cấp góc nhìn thống kê đầy đủ.

Phần mềm nào hỗ trợ tốt nhất cho việc tính toán độ đồng thuận của dữ liệu định tính?

SPSS phù hợp cho xử lý các biến danh mục đã được mã hóa thành số lượng. NVivo là phần mềm ưu việt nhất cho việc kiểm tra trực tiếp trên nền tảng văn bản thô, trong khi R cung cấp các thuật toán đo lường độ linh hoạt cao nhất khi nghiên cứu có từ 3 rater trở lên.

Bài viết đã hệ thống hóa toàn bộ khung lý thuyết và hướng dẫn thực hành cách tính độ đồng thuận thông qua hệ số Cohen’s Kappa và Fleiss’ Kappa. Việc nắm vững khái niệm Độ tin cậy liên quan sát viên là nền tảng tối quan trọng để các nhà nghiên cứu xác thực chất lượng mã hóa dữ liệu. Nội dung bài viết được tổng hợp, phân tích chuẩn khoa học và chia sẻ bởi giảng viên Nguyễn Thanh Phương.

Giảng viên Nguyễn Thanh Phương là chuyên gia chuyên sâu về Nghiên cứu khoa học, Ứng dụng AI, Digital Marketing và Quản trị bản thân. Với kinh nghiệm giảng dạy thực chiến, tác giả trực tiếp hướng dẫn ứng dụng phương pháp luận và phân tích dữ liệu chuyên sâu cho người học nên được sinh viên gọi là Thầy giáo quốc dân. Mọi nội dung chia sẻ đều tuân thủ nguyên tắc khách quan, thực chứng và mang giá trị ứng dụng cao, hướng tới mục tiêu cốt lõi: “Làm bạn tốt hơn!